生成AIは、企業がコンテンツを扱う方法に革命を起こし、より高い効率性を実現し、意思決定プロセスを強化する可能性を秘めています。

膨大なデータセットとコードでトレーニングされた大規模言語モデル(LLM)を使用することで、生成AIはパターンを識別し、文脈を理解し、テキストや画像、さらには動画まで、人間が作成したコンテンツのようなアウトプットを生成することができます。そして、これらすべては、検索拡張生成(RAG)と呼ばれる画期的なAI技術によって実現しています。

RAGが企業にとって重要な理由

生成AIの機能が急速に進化する中、ほとんどの企業が、ビジネス目標を強化して達成するために、また競合他社に先んじるために、業務全体でAIをより活用する戦略を立てています。

企業のユースケースにおいて、AIによって生成されるコンテンツとインサイトは、LLMに提供されるコンテキスト情報と関連情報の量に左右されます。RAGを使用することで、LLMは、モデルを圧倒するリスクを冒すことなく、大量の情報を調べることができます。

公開されているAIモデルのほとんどがRAGを活用していますが、これらのLLMは公開されているコンテンツでトレーニングされています。RAGのテクノロジーをユースケース活用したいと考えている企業は、文脈に沿った回答を生成し、ハルシネーションを回避するために、LLMが自社の特定のデータでトレーニングされていることを確認する必要があります。これは現在、セキュリティ上の課題となっています。企業は、RAGを安全な方法で活用し、適切なコンテンツを生成するAI技術を必要としている一方で、コンテンツの安全性、プライバシー、コンプライアンスを維持する必要があります。

AIが「安全」であるとは?

買収など機密性の高いデータが関係するシナリオを想像してみてください。買収の担当者のひとりが、機密性の高い財務資料や従業員の給与、そのほかの重要な情報についてデューデリジェンスを行うことを任されています。

このような場合、AIは非常に有益です。インサイトを提供し、戦略を特定し、リスクを評価し、複雑な文書を要約することができます。しかし、その結果AIモデルは、ユーザーが知り得ない情報を含む機密性の高いデータにアクセスすることになります。これは、情報漏洩のリスクをもたらします。

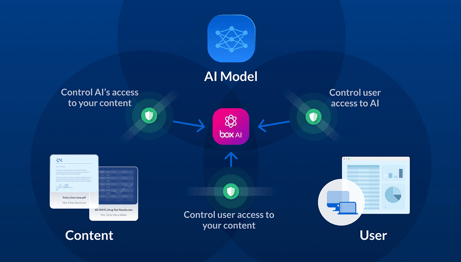

このシナリオは、企業がAIを活用する際に考慮すべきセキュリティとプライバシーに関する3つの重要事項を示しています。

- コンテンツのユーザーアクセスに対する適切な権限: すべてのユーザーが、雇用契約書や財務予想などの機密コンテンツにアクセスできるべきではありません。ユーザーがアクセスできるのは、業務に必要なコンテンツに限られるべきです。

- AIへの適切なユーザーアクセス: AI自体に対するユーザー権限を管理して、データが適切なユーザーの手に渡るようにします。たとえば、社外ユーザーによるBox AIの利用を制限しながら、社外ユーザーとコラボレーションできます。適切な制御なしにすべてのユーザーがAIにアクセスできるようにすると、データの不正な流出や悪用につながる可能性があります。たとえば、従業員がレポート作成中に機密性の高い顧客情報を漏らしてしまうかもしれません。AIへのアクセスを特定のユーザーとコンテンツに制限することで、データを保護し、GDPRなどの規制に準拠し、潜在的な漏洩リスクを防ぐことができます。

- AIによる適切なコンテンツへのアクセス: さらに、AIモデル自身が、クエリを実行するユーザーがアクセスできるコンテンツのみを参照できるように、AI連携にガードレールを組み込む必要があります。

これらの対策を実施することで、機密情報を不正アクセスから保護し、AIシステムが誤って個人情報を公開することを防ぐことができます。これにより、ユーザーのプライバシーを保護し、企業の信頼を維持し、AIの悪用に関連する潜在的なリスクを軽減できます。

しかし、このレベルのきめ細やかな許可とアクセス制御を可能にすることは、多くの企業にとって解決が困難な問題です。AIとAIが参照するナレッジベースは、ユーザーがアクセスできるものでなければならないユースケースが多くあります。そうでなければ、ユーザーが見るべきでない情報が明らかになる危険性があります。

言い換えれば、企業は実際のRAGプロセスが開始される前であっても、AIがコンテンツとユーザーの権限を尊重することを信頼できる方法が必要です。

セキュアでエンタープライズグレードのインテリジェントコンテンツ管理

企業がRAGを活用するために解決しなければいけない重要な課題が、権限です。

企業には、RAGを安全かつ権限統合された方法で活用できるAIテクノロジーが必要です。コンテンツの安全性、プライバシー、コンプライアンスを維持しながら、適切な回答を生成する必要があります。

そこで、Box AIの「セキュアRAG」がお役に立ちます。

「セキュアRAG」が最大の懸念事項に対処

Box AIは、RAGの関するこれら3つの企業の懸念をすべて解決します。

- きめ細やかなユーザー権限チェックにより、適切なユーザが適切なコンテンツにアクセスできるので、ユーザーはアクセスを許可されたファイルやコンテンツのみを表示、操作できます。Box AIはファイルに設定された権限を常に参照し、ユーザーが特定のコンテンツにアクセスできることを確認します。

- Box AIによる追加のユーザー設定チェックにより、適切なユーザーがAIにアクセスできます。管理者は、管理コンソールでユーザーがBox AIを利用できるサービスを設定することもできます。たとえば、派遣社員や契約社員はBox AIを利用できませんが、生成されたコンテンツをBox Hubsで閲覧できるように設定できます。

- Box AIは、質問するユーザーがアクセスできるコンテンツのみを参照するため、AIによるデータ漏洩のリスクを低減できます。ユーザーは、Box Notes内のテキストを選択してBox AIを呼び出すことができ、Box AIはハイライトされたテキストのみをプロンプトに含めます。プレビューで開かれたドキュメント内でBox AIを起動すると、Box AIは開かれているドキュメント内のコンテンツのみをプロンプトに追加します。Box AIは、Hubsにキュレーションされたコンテンツのみを活用してプロンプトを追加し、文脈に応じた適切な回答を提供します。

AIモデルが参照するコンテンツの範囲を決定する権限を組織に委ねることで、Boxは以下の2つの重要事項を保証します。

- AIが参照範囲外のドキュメントまたはドキュメントのコーパスを活用して、無関係またはコンプライアンス違反の回答を返すリスクを低減します。

- Box AIによって生成される結果は、ユーザーの権限を考慮しながら、より高品質で、より関連性の高いものにします。

セキュアでエンタープライズグレードのAIを提供するコンテンツパートナー

Box AIは、エンタープライズグレードの規格を提供するように設計されており、保護とセキュリティを維持しながら、最新のAI機能をコンテンツに適用できます。これを実現する方法のひとつが、「セキュアRAG」です。「セキュアRAG」は、AIとコンテンツの完全なアクセス制御を提供するだけでなく、特定のユースケースに適応する柔軟性も兼ね揃えています。

データセキュリティとAIの安全な利用は、Boxが適用するサービスの重要な要素です。このコミットメントを強化するために、一連のAI原則を公開し、準拠しています。これらの原則は、BoxのAIテクノロジーの開発と展開の指針であり、Boxの価値がお客様の厳格なセキュリティと要件に一致するように取り組んでいます。

信頼できるAIで、Boxが企業をどのように支援しているのかをご覧ください。

Boxは、お客様の明示的な同意なしにBox AIのプロンプトとその結果の出力を保存しません。AIモデルサービスパートナーにも保存を許可していません。AIモデルプロバイダから回答が返されると、情報はプロバイダのシステムから削除されます。Boxのドキュメントまたはアプリケーションを閉じると、すべての質問と回答の情報がBox AIから削除されます。

Box AIなら、企業はデータが細心の注意と整合性を持って取り扱われていることを認識しながら、高度なAIツールを安心して利用できます。詳しくは、こちらをご覧ください。

Box AIの仕組みの詳細は、このホワイトペーパーをご覧ください。

※このブログは Box, Inc 公式ブログ(https://blog.box.com/)2024年10月8日(日本時間10月9日)付投稿の翻訳です。

著者:Meena Ganesh, Sr. Product Marketing Manager at Box

原文リンク:https://blog.box.com/secure-rag-powering-and-safeguarding-ai-innovation

- トピックス:

- Box製品情報